Pakar kardiologi melatih model AI yang besar untuk menilai struktur dan fungsi jantung

Ulasan terakhir: 14.06.2024

Semua kandungan iLive disemak secara perubatan atau fakta diperiksa untuk memastikan ketepatan faktual sebanyak mungkin.

Kami mempunyai garis panduan sumber yang ketat dan hanya memautkan ke tapak media yang bereputasi, institusi penyelidikan akademik dan, apabila mungkin, dikaji semula kajian secara medis. Perhatikan bahawa nombor dalam kurungan ([1], [2], dan lain-lain) boleh diklik pautan ke kajian ini.

Jika anda merasakan bahawa mana-mana kandungan kami tidak tepat, ketinggalan zaman, atau tidak dipersoalkan, sila pilih dan tekan Ctrl + Enter.

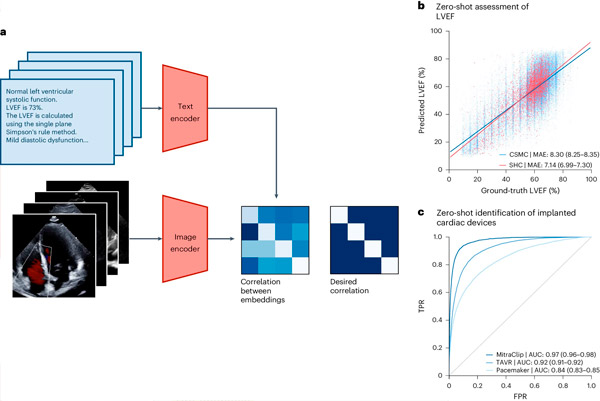

Pakar kecerdasan buatan dari Cedars-Sinai dan Smidt Heart Institute mencipta set data lebih daripada 1 juta ekokardiogram (ultrasound video jantung) dan tafsiran klinikal yang sepadan. Menggunakan pangkalan data ini, mereka membangunkan EchoCLIP, algoritma pembelajaran mesin yang berkuasa yang boleh "mentafsir" imej ekokardiogram dan menilai penunjuk utama.

Reka bentuk dan penilaian EchoCLIP, yang diterangkan dalam makalah yang diterbitkan dalam Perubatan Alam, mencadangkan bahawa tafsiran ekokardiogram pesakit menggunakan EchoCLIP menyediakan penilaian klinikal peringkat pakar, termasuk penilaian fungsi jantung, hasil pembedahan yang lalu dan peranti implan, dan juga boleh membantu doktor mengenal pasti pesakit yang memerlukan rawatan.

Model asas EchoCLIP juga boleh mengenal pasti pesakit yang sama merentas berbilang video, peperiksaan dan titik masa serta mengenali perubahan penting secara klinikal dalam hati pesakit.

“Untuk pengetahuan kami, ini adalah model terbesar yang dilatih pada imej ekokardiografi," kata pengarang utama kajian David Ouyang, MD, ahli fakulti Bahagian Kardiologi di Institut Jantung Smidt dan Jabatan Kecerdasan Buatan dalam Perubatan.

"Banyak model AI sebelumnya untuk ekokardiogram dilatih hanya menggunakan puluhan ribu contoh. Sebaliknya, prestasi tinggi unik EchoCLIP dalam tafsiran imej adalah hasil latihan pada hampir sepuluh kali lebih banyak data daripada model sedia ada."

“Hasil kami menunjukkan bahawa set data pengimejan perubatan dan tafsiran yang besar dan disemak semula boleh dijadikan asas untuk melatih model perubatan asas, yang merupakan satu bentuk kecerdasan buatan generatif,” tambah Ouyang.

Aliran kerja EchoCLIP. Sumber: Perubatan Alam (2024). DOI: 10.1038/s41591-024-02959-y

Beliau menyatakan bahawa model garis dasar lanjutan ini tidak lama lagi boleh membantu pakar kardiologi menilai ekokardiogram dengan menjana anggaran awal ukuran jantung, mengenal pasti perubahan dari semasa ke semasa dan penyakit biasa.

Pasukan penyelidik mencipta set data 1,032,975 video ultrasound jantung dan tafsiran pakar yang berkaitan untuk membangunkan EchoCLIP. Penemuan utama daripada kajian termasuk:

- EchoCLIP telah menunjukkan prestasi tinggi dalam menilai fungsi jantung daripada imej jantung.

- Model asas dapat mengenal pasti peranti intrakardiak yang diimplan seperti perentak jantung, injap mitral dan aorta yang diimplan daripada imej ekokardiogram.

- EchoCLIP dengan tepat mengenal pasti pesakit unik merentas kajian, mengenal pasti perubahan penting secara klinikal seperti pembedahan jantung sebelumnya dan membenarkan pembangunan tafsiran teks awal bagi imej ekokardiogram.

"Model garis dasar ialah salah satu bidang terbaharu dalam AI generatif, tetapi kebanyakan model tidak mempunyai data perubatan yang mencukupi untuk berguna dalam penjagaan kesihatan," kata Christina M. Albert, MD, MPH, pengerusi Bahagian Kardiologi di Institut Jantung Smidt.

Albert, yang tidak terlibat dalam kajian itu, menambah: "Model garis dasar baharu ini menyepadukan penglihatan komputer untuk tafsiran imej ekokardiogram dengan pemprosesan bahasa semula jadi untuk meningkatkan tafsiran pakar kardiologi."